Les services cloud d’IA traditionnels reposent principalement sur de grands centres de données centralisés. Ce modèle offre une puissance de calcul conséquente, mais il entraîne aussi des coûts GPU élevés, une gestion centralisée des ressources et des difficultés de montée en charge. Theta EdgeCloud vise à résoudre ces problématiques en intégrant des nœuds Edge à l’informatique cloud, exploitant les GPU inactifs à l’échelle mondiale pour optimiser l’utilisation des ressources et favoriser la collaboration distribuée.

Dans un contexte de concurrence accrue pour l’infrastructure IA, Theta EdgeCloud s’impose comme un exemple de DePIN (Decentralized Physical Infrastructure Network, réseau d’infrastructure physique décentralisée) et de réseau GPU distribué. Son objectif n’est pas de remplacer totalement les plateformes cloud classiques, mais d’offrir un modèle plus flexible pour la collaboration des ressources dans l’inférence IA et l’edge computing.

## Qu’est-ce que Theta EdgeCloud ?

Theta EdgeCloud est une plateforme cloud hybride d’IA développée sur l’écosystème [Theta Network](https://www.gate.com/fr/learn/articles/what-is-theta-network). Son principe consiste à associer des Edge Nodes distribués à des services GPU cloud traditionnels, pour créer un réseau unifié de ressources de calcul.

Contrairement aux services cloud IA centralisés, Theta EdgeCloud puise la puissance de calcul non seulement dans les serveurs cloud, mais aussi dans des [Edge Node](https://www.gate.com/fr/learn/articles/theta-node-architecture) exploités par des utilisateurs du monde entier. Ces nœuds partagent leurs ressources GPU, CPU et bande passante inutilisées pour des tâches d’inférence IA, de transcodage vidéo ou de rendu.

Pour les développeurs, Theta EdgeCloud constitue une couche dynamique de calcul IA sur des ressources distribuées. Il n’est pas nécessaire de gérer directement les nœuds : il suffit de soumettre les tâches sur la plateforme, qui assure l’allocation et l’exécution des ressources de façon automatique.

## Quelles différences entre Theta EdgeCloud et les services cloud IA traditionnels ?

Les plateformes cloud IA classiques reposent sur de grands centres de données fournissant de façon centralisée des services GPU, la gestion des ressources étant assurée par le fournisseur cloud. Ce modèle, éprouvé et stable, reste exposé aux pénuries de GPU et à la hausse des coûts.

À l’inverse, Theta EdgeCloud privilégie le « partage de ressources en périphérie ». Les Edge Nodes, situés partout dans le monde, permettent de valoriser les GPU inutilisés. Lorsqu’une tâche IA est soumise, la plateforme attribue les ressources selon les besoins de la tâche, l’état des nœuds et la puissance de calcul disponible.

Les différences majeures entre Theta EdgeCloud et les plateformes cloud IA traditionnelles sont :

| Dimension de comparaison | Plateforme cloud IA traditionnelle | Theta EdgeCloud |

| --- | --- | --- |

| Source des ressources | Centre de données centralisé | GPU cloud + Edge Node |

| Structure du réseau | Centralisée | Distribuée |

| Planification GPU | Gérée par la plateforme | Coordination dynamique des nœuds |

| Participation des nœuds | Fournisseur cloud | Ressources partagées par les utilisateurs |

| Mécanisme d’incitation | Paiement du service | Récompenses TFUEL |

Ainsi, Theta EdgeCloud se positionne comme un réseau GPU distribué et non comme une simple plateforme cloud classique.

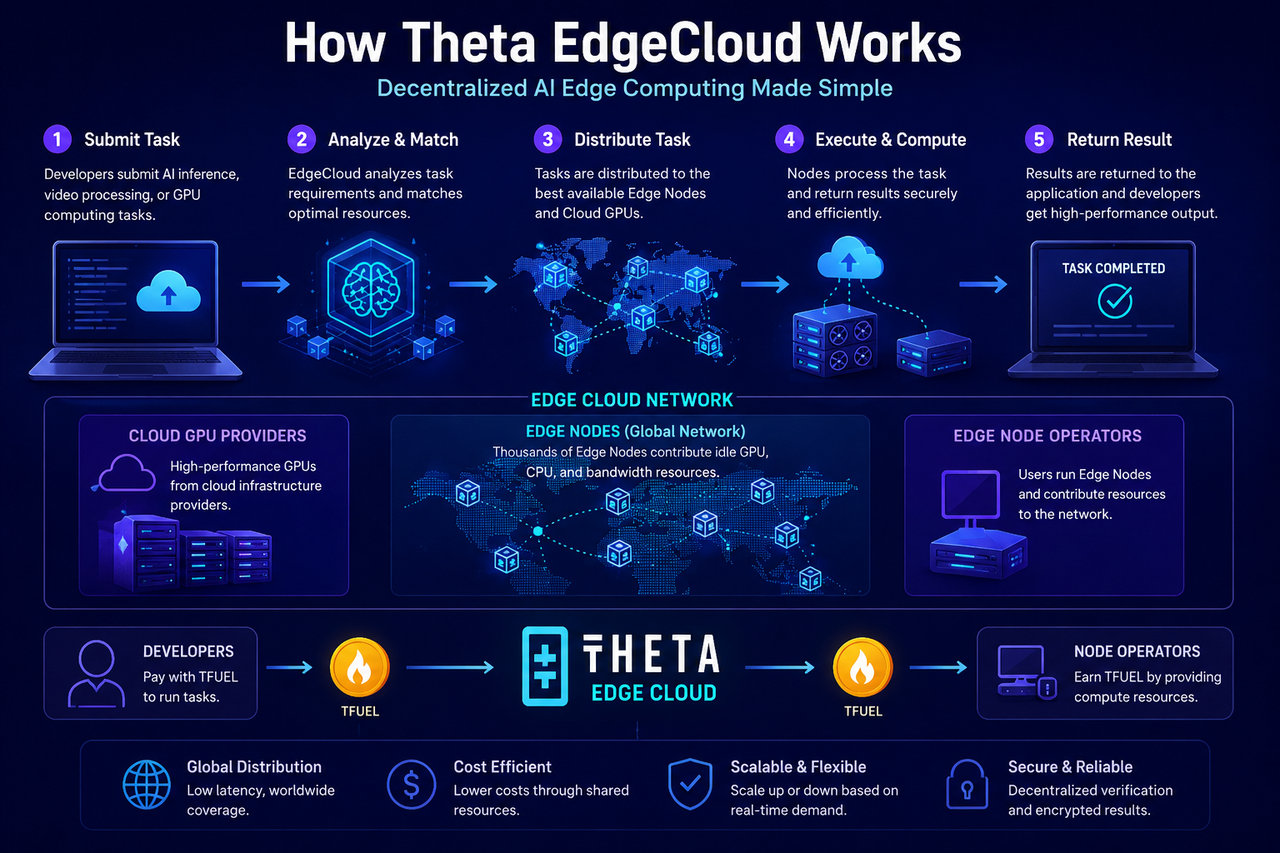

## Que se passe-t-il après la soumission d’une tâche IA ?

Lorsqu’un développeur ou une application soumet une tâche d’inférence IA, de traitement vidéo ou de rendu, Theta EdgeCloud analyse d’abord les besoins en ressources : type de GPU, VRAM, temps de calcul, bande passante.

Le système repère ensuite les nœuds adaptés sur le réseau. Certaines tâches sont traitées par des GPU cloud, d’autres confiées à des Edge Nodes du monde entier pour un traitement collaboratif. Ce processus est entièrement automatisé, sans sélection manuelle des nœuds par les développeurs.

Pendant l’exécution, le système surveille en continu le statut des nœuds et l’évolution de la tâche. Si un nœud se déconnecte ou manque de ressources, la tâche est réaffectée pour garantir la stabilité du calcul.

Une fois la tâche terminée, le résultat est transmis à la couche applicative et les nœuds participants reçoivent des [récompenses TFUEL](https://www.gate.com/fr/learn/articles/theta-vs-tfuel) selon leur contribution en ressources.

Ce modèle agit comme un « système de planification des ressources distribué », conçu pour unifier et maximiser l’utilisation de la puissance de calcul inutilisée du réseau.

## Comment les Edge Nodes interviennent-ils dans le calcul GPU ?

Les Edge Nodes sont au cœur de Theta EdgeCloud. En exécutant un Edge Node, l’utilisateur connecte ses ressources GPU et de calcul locales au réseau Theta.

Lorsque le réseau a besoin d’inférence IA, de rendu vidéo ou d’edge computing, ces nœuds reçoivent dynamiquement des tâches. Après exécution, ils perçoivent des récompenses TFUEL proportionnelles à leur contribution.

Contrairement aux machines de minage classiques, les Edge Nodes de Theta ne servent pas au minage PoW ; leur vocation première est d’apporter de la puissance de calcul réelle. C’est aussi pour cela que Theta est reconnu comme un projet DePIN.

Pour l’utilisateur, l’Edge Node constitue à la fois un point d’entrée dans le réseau Theta et une brique clé du partage de ressources.

## Comment TFUEL circule-t-il dans EdgeCloud ?

TFUEL est le token de ressource central de Theta EdgeCloud, utilisé à la fois pour les paiements réseau et les incitations.

Les développeurs règlent leurs frais de ressources en TFUEL lors de la soumission de tâches IA ou vidéo. Le système redistribue ensuite une part de TFUEL aux Edge Nodes impliqués dans le calcul, en fonction de la performance de chaque tâche.

Dans l’écosystème EdgeCloud, TFUEL relie :

- Les développeurs d’applications IA

- Les fournisseurs de ressources GPU

- Le réseau Edge Node

- L’infrastructure Theta

Il s’agit d’un cycle continu : « paiement de la tâche — exécution de la ressource — récompense du nœud ».

## Scénarios d’application principaux de Theta EdgeCloud

Theta EdgeCloud cible principalement l’IA et le calcul média.

Pour l’IA, les usages sont :

- Inférence de modèles IA

- Inférence de grands modèles de langage

- Génération d’images

- Calcul GPU distribué

Pour la vidéo et les médias, Theta EdgeCloud prend en charge :

- Transcodage vidéo

- Rendu vidéo

- Diffusion en direct

- Livraison de contenu en périphérie

Grâce à la répartition mondiale des Edge Nodes, les tâches sensibles à la latence bénéficient de délais réduits grâce à l’edge computing.

À mesure que l’IA s’intègre à l’infrastructure Web3, Theta EdgeCloud devient un pilier de l’expansion de Theta, du streaming vidéo vers l’IA.

## Quels défis pour Theta EdgeCloud ?

Malgré les atouts des réseaux GPU distribués pour le partage des ressources et la montée en charge, Theta EdgeCloud doit relever plusieurs défis concrets.

D’une part, le matériel des Edge Nodes est hétérogène et les écarts de performance GPU peuvent influencer l’efficacité des tâches. La nature distribuée accroît également la complexité de la gestion des ressources et du suivi des tâches.

Par ailleurs, le marché de l’infrastructure IA est de plus en plus concurrentiel, avec des plateformes cloud classiques et d’autres projets GPU distribués en compétition pour les parts de marché.

Enfin, avec la montée en puissance de l’IA générative, la demande en GPU haute performance s’intensifie, rendant l’acquisition et l’allocation fiables de GPU cruciales pour EdgeCloud sur le long terme.

## Résumé

Theta EdgeCloud, la plateforme décentralisée d’IA et d’edge computing de Theta Network, vise à bâtir un réseau de calcul IA distribué en s’appuyant sur des Edge Nodes mondiaux et des GPU cloud.

Contrairement aux services cloud IA centralisés, Theta EdgeCloud privilégie le partage des ressources en périphérie, la coordination GPU et la planification distribuée. Les développeurs soumettent leurs tâches d’inférence IA ou de traitement vidéo via la plateforme, tandis que les nœuds du monde entier fournissent des ressources et perçoivent des récompenses TFUEL.

Avec la demande croissante pour l’inférence IA et les GPU, Theta EdgeCloud accompagne la transformation de Theta, du streaming vidéo vers une plateforme d’infrastructure IA globale.

## FAQ

### Comment fonctionne Theta EdgeCloud ?

Après la soumission d’une tâche IA ou vidéo par un développeur, le système l’attribue automatiquement aux GPU cloud et aux Edge Nodes pour un traitement collaboratif, TFUEL servant aux paiements de ressources et aux récompenses.

### Quel est le rôle des Edge Nodes dans EdgeCloud ?

Les Edge Nodes fournissent les ressources GPU et de calcul pour les tâches d’inférence IA, de rendu vidéo et d’edge computing.

### En quoi Theta EdgeCloud diffère-t-il des services cloud IA traditionnels ?

Les clouds IA traditionnels reposent sur des centres de données centralisés, tandis que Theta EdgeCloud exploite à la fois les Edge Nodes et les GPU cloud pour former un réseau de ressources distribué.

### Quelle est la fonction du TFUEL dans EdgeCloud ?

TFUEL sert à régler les tâches IA et vidéo, et constitue également le token de récompense pour les nœuds exécutant les tâches.

### Theta EdgeCloud est-il considéré comme un projet DePIN ?

Parce qu’il se concentre sur le partage des ressources GPU et d’edge computing, Theta EdgeCloud est souvent classé comme projet DePIN et réseau GPU distribué.

2026-05-08 06:25:15