Google Kembali Terjun ke Perlombaan AI Open Source dengan Gemma 4

Singkatnya

- Google merilis Gemma 4, sebuah keluarga model open di bawah lisensi Apache 2.0.

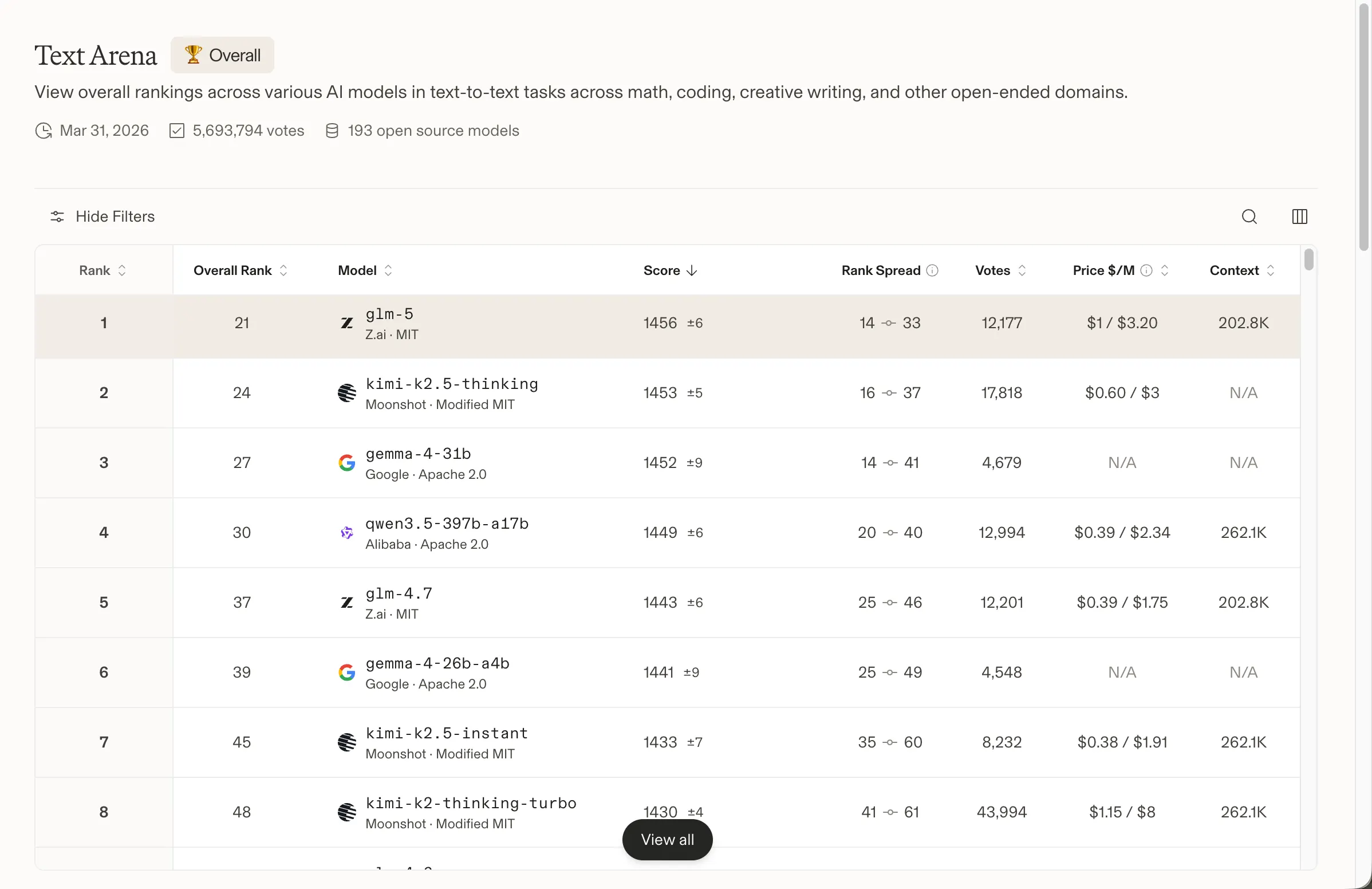

- Rangkaian yang terdiri dari empat model mencakup perangkat ponsel hingga pusat data, dengan model 31B yang sudah menempati peringkat #3 secara global.

- AI sumber terbuka AS mendapat dorongan yang dibutuhkan, karena Gemma 4—didukung oleh DeepMind—memposisikan dirinya sebagai kandidat Amerika paling kuat melawan DeepSeek, Qwen, dan pemimpin Tiongkok lainnya.

Ambisi Google di bidang AI sumber terbuka hari ini menjadi jauh lebih serius. Perusahaan merilis Gemma 4, sebuah keluarga yang terdiri dari empat model open-weight yang dibangun di atas riset yang sama seperti Gemini 3, dan dilisensikan di bawah Apache 2.0—sebuah perubahan besar dibanding ketentuan yang lebih ketat pada versi Gemma sebelumnya. Pengembang telah mengunduh generasi Gemma sebelumnya lebih dari 400 juta kali, memunculkan lebih dari 100.000 varian komunitas. Rilis ini adalah yang paling ambisius sejauh ini.

Kami baru saja merilis Gemma 4 — model open paling cerdas kami hingga saat ini.

Dibangun dari riset kelas dunia yang sama seperti Gemini 3, Gemma 4 menghadirkan kecerdasan terobosan langsung ke perangkat keras Anda sendiri untuk penalaran tingkat lanjut dan alur kerja berbasis agen.

Dirilis di bawah lisensi komersial… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2 April 2026

Selama setahun terakhir, papan peringkat AI sumber terbuka sebagian besar didominasi urusan Tiongkok. DeepSeek, Minimax, GLM, dan Qwen telah menguasai posisi teratas, membuat alternatif Amerika kewalahan untuk tetap relevan. Seperti yang dilaporkan Decrypt tahun lalu, model open Tiongkok naik dari hanya sekitar 1,2% penggunaan model open global pada akhir 2024 menjadi kira-kira 30% pada akhir 2025, dengan Qwen milik Alibaba bahkan mengungguli Llama milik Meta sebagai model self-hosted yang paling banyak digunakan di seluruh dunia. Llama milik Meta dulu menjadi pilihan default bagi pengembang yang menginginkan model yang mumpuni dan bisa dijalankan secara lokal. Reputasi itu terkikis—lisensi Meta yang mengontrol Llama memunculkan pertanyaan tentang status open-source sejatinya, dan performanya menurun tertinggal di belakang persaingan dari Tiongkok. Keluarga OLMo milik Allen Institute mencoba mengisi celah tersebut tetapi gagal mendapatkan daya tarik yang berarti. OpenAI merilis model gpt-oss-nya pada Agustus 2025, memberi ekosistem napas segar, tetapi model-model itu tidak pernah dirancang untuk menjadi pesaing lini terdepan. Dan kemarin, sebuah startup AS beranggotakan 30 orang bernama Arcee AI merilis Trinity, model open dengan 400 miliar parameter yang membuat argumen meyakinkan bahwa panggung Amerika belum benar-benar mati. Gemma 4 mengikuti momentum itu, kali ini dengan seluruh bobot Google DeepMind di belakangnya, menjadikannya—secara argumen—model Amerika terbaik di kancah AI sumber terbuka. Model ini “dibangun dari riset dan teknologi kelas dunia yang sama seperti Gemini 3,” kata Google dalam pengumumannya. Gemma 4 hadir dalam empat ukuran: Effective 2B dan 4B untuk ponsel serta perangkat edge, model 26B Mixture of Experts yang berfokus pada kecepatan, dan model Dense 31B yang dioptimalkan untuk kualitas mentah.

Dense 31B saat ini menempati peringkat ketiga di antara semua model open di papan peringkat teks Arena AI. MoE 26B berada di urutan keenam. Google mengklaim keduanya mengungguli model yang berukuran 20 kali lebih besar—klaim itu setidaknya terbukti benar jika dibandingkan dengan angka-angka Arena AI, di mana model Tiongkok masih memegang dua posisi teratas.

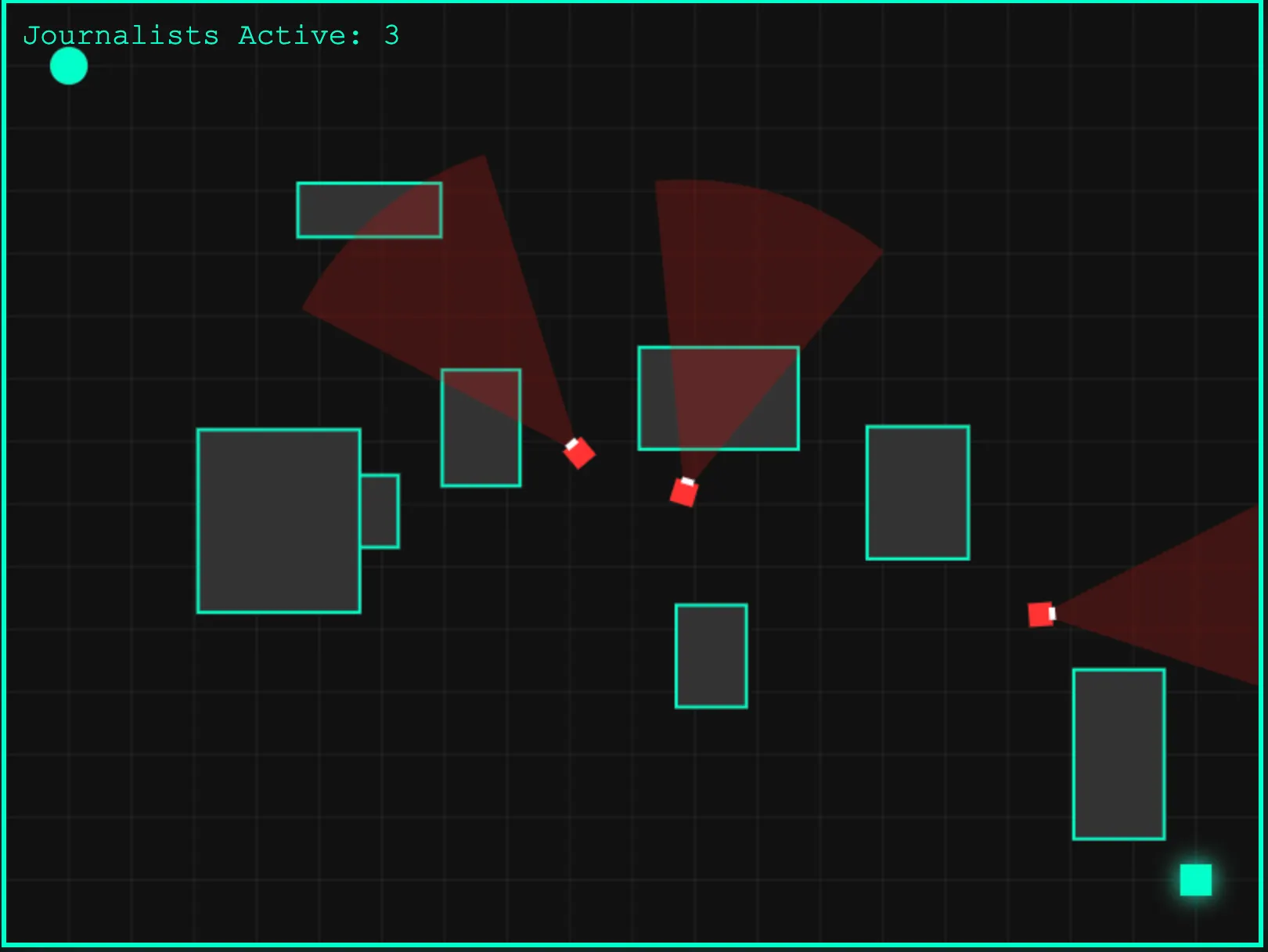

Kami menguji Gemma 4. Ia mampu, dengan beberapa catatan. Model ini menerapkan penalaran bahkan pada tugas yang sebenarnya tidak memerlukannya, sehingga jawaban bisa terasa terlalu dibuat-buat untuk prompt yang sederhana. Penulisan kreatif cukup bagus—memadai, tidak menginspirasi—dan kemungkinan membaik dengan panduan yang lebih spesifik dan teknik rekayasa prompt. Di mana ia paling jelas memberikan hasil adalah pada kode. Saat diminta membuat sebuah game, outputnya tidak terlalu mencolok atau rumit, tetapi berjalan tanpa error pada percobaan pertama. Tidak buruk untuk model 41 miliar parameter. Keandalan zero-shot ini—secara argumen—lebih berharga daripada hasil yang lebih indah namun butuh proses debug. Anda bisa mencoba game tersebut di sini.

Keempat varian mencakup spektrum perangkat keras secara penuh. Model E2B dan E4B dibuat untuk ponsel Android, Raspberry Pi, dan perangkat edge, berjalan sepenuhnya offline dengan latensi nyaris nol, masukan audio native, dan jendela konteks 128K. Model 26B dan 31B menargetkan workstation dan deployment cloud, memperpanjang konteks hingga 256K serta menambahkan pemanggilan fungsi native dan output JSON terstruktur untuk membangun agen otonom. Keempat model memproses gambar dan video secara native. Bobot full-precision dari model yang lebih besar muat pada satu GPU NVIDIA H100 berkapasitas 80GB; versi yang di-quantize berjalan pada perangkat keras konsumen. Lisensi Apache 2.0 adalah headline lainnya. Rilis Gemma sebelumnya dari Google menggunakan lisensi khusus yang menciptakan ambiguitas hukum untuk produk komersial. Apache 2.0 menghilangkan gesekan itu sepenuhnya—pengembang dapat memodifikasi, mendistribusikan ulang, dan mengkomersialkan tanpa perlu khawatir bahwa Google akan mengubah ketentuannya di kemudian hari. Co-founder Hugging Face, Clement Delangue, memujinya, dengan mengatakan bahwa “Local AI sedang berada di momen-nya,” dan ini adalah masa depan industri AI. CEO Google DeepMind Demis Hassabis melangkah lebih jauh, menyebut Gemma 4 “model open terbaik di dunia untuk ukuran masing-masing.”

Teruja untuk meluncurkan Gemma 4: model open terbaik di dunia untuk ukuran masing-masing. Tersedia dalam 4 ukuran yang bisa disesuaikan (fine-tuned) untuk tugas spesifik Anda: 31B dense untuk performa mentah yang hebat, 26B MoE untuk latensi rendah, dan effective 2B & 4B untuk penggunaan perangkat edge - selamat membangun! pic.twitter.com/Sjbe3ph8xr

— Demis Hassabis (@demishassabis) 2 April 2026

Itu klaim yang kuat. Sistem proprietari dari Anthropic, OpenAI, dan Gemini milik Google sendiri masih memimpin pada benchmark tersulit. Namun untuk model open-weight yang bisa Anda jalankan secara lokal, modifikasi secara bebas, dan deploy pada infrastruktur Anda sendiri? Persaingannya baru saja menjadi jauh lebih tipis. Anda bisa mencoba Gemma 4 sekarang di Google AI Studio (31B dan 26B) atau Google AI Edge Gallery (E2B dan E4B). Bobot model juga tersedia di Hugging Face, Kaggle, dan Ollama.