Como opera o Theta EdgeCloud: explicação pormenorizada de todo o fluxo de trabalho de computação periférica de IA

Os serviços tradicionais de IA na cloud assentam geralmente em grandes centros de dados centralizados. Embora este modelo proporcione enorme poder computacional, acarreta custos elevados de GPU, gestão centralizada de recursos e limitações de escalabilidade. A Theta EdgeCloud procura superar estes obstáculos ao integrar nodos de edge com computação em cloud—agregando GPUs ociosas de todo o mundo numa rede unificada, potenciando a utilização eficiente dos recursos e promovendo a colaboração distribuída.

Com a intensificação da concorrência na infraestrutura de IA, a Theta EdgeCloud destaca-se como referência no universo DePIN (Decentralized Physical Infrastructure Network) e como solução avançada de rede GPU distribuída. Em vez de substituir as plataformas cloud tradicionais, o seu propósito é oferecer colaboração flexível de recursos para inferência de IA e cenários de computação edge.

O que é a Theta EdgeCloud

A Theta EdgeCloud é uma plataforma híbrida de IA na cloud, construída no ecossistema Theta Network. A sua abordagem consiste em combinar Edge Nodes distribuídos com serviços de GPU em cloud tradicionais, formando uma rede única de recursos computacionais.

Ao contrário dos serviços centralizados convencionais de IA na cloud, a Theta EdgeCloud recorre não só a servidores cloud, mas também a nodos Edge Node operados por utilizadores em todo o mundo. Estes nodos partilham GPUs, CPUs e largura de banda ociosas para alimentar tarefas de inferência de IA, transcodificação de vídeo e renderização.

Para programadores, a Theta EdgeCloud funciona como camada de computação de IA, orquestrando recursos distribuídos de modo dinâmico. Basta submeter tarefas na plataforma—o sistema gere automaticamente a alocação e execução dos recursos, sem necessidade de gestão direta dos nodos.

Como se distingue a Theta EdgeCloud dos serviços tradicionais de IA na cloud

As plataformas tradicionais de IA na cloud assentam em grandes centros de dados para serviços centralizados de GPU, ficando a gestão e o agendamento de recursos a cargo do fornecedor cloud. Embora este modelo seja estável e consolidado, está sujeito à escassez de GPU e ao aumento de custos.

Já a Theta EdgeCloud promove a “partilha de recursos edge”. Edge Nodes em todo o mundo podem disponibilizar GPUs ociosas para reutilização. Ao submeter uma tarefa de IA, a plataforma distribui recursos tendo em conta os requisitos da tarefa, o estado dos nodos e a capacidade computacional disponível.

As principais diferenças entre a Theta EdgeCloud e as plataformas cloud tradicionais de IA são:

| Dimensão de comparação | Plataforma tradicional de IA na cloud | Theta EdgeCloud |

|---|---|---|

| Origem do recurso | Centro de dados centralizado | Cloud GPU + Edge Node |

| Estrutura da rede | Centralizada | Distribuída |

| Agendamento de GPU | Gestão centralizada da plataforma | Colaboração dinâmica de nodos |

| Participação dos nodos | Fornecedor de serviços cloud | Recursos partilhados por utilizadores |

| Mecanismo de incentivo | Taxas de serviço | Mecanismo de recompensa TFUEL |

Esta abordagem posiciona a Theta EdgeCloud como uma verdadeira rede GPU distribuída, distinta das plataformas convencionais de computação cloud.

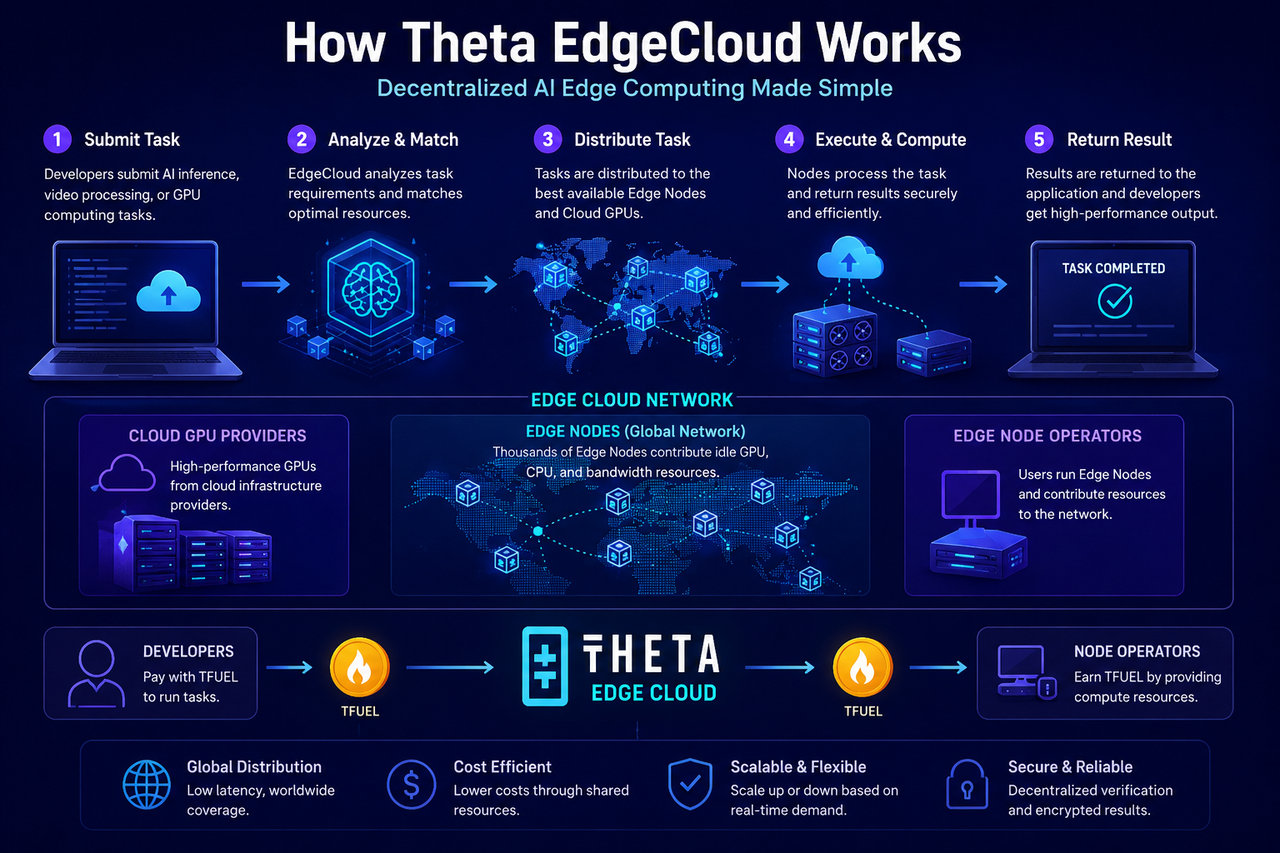

O que acontece quando são submetidas tarefas de IA

Ao submeterem tarefas de inferência de IA, processamento de vídeo ou renderização, programadores ou aplicações veem a Theta EdgeCloud analisar, em primeiro lugar, os requisitos de recursos—including tipo de GPU, memória, tempo de computação e largura de banda.

O sistema localiza recursos de nodos adequados em toda a rede. Algumas tarefas são processadas por GPUs cloud; outras são distribuídas por Edge Nodes globais para processamento colaborativo. Todo o processo é automático—não é necessária seleção manual de nodos por parte dos programadores.

Durante a execução, o sistema monitoriza continuamente o estado dos nodos e o progresso das tarefas. Se algum nodo ficar offline ou sem recursos, a plataforma reatribui tarefas automaticamente para garantir estabilidade computacional.

No final, os resultados são devolvidos à camada de aplicação e os nodos participantes recebem recompensas TFUEL de acordo com os recursos disponibilizados.

Trata-se essencialmente de um “sistema distribuído de agendamento de recursos” que agrega a utilização do poder computacional ocioso da rede.

Como contribuem os Edge Nodes para a computação GPU

Os Edge Nodes são centrais para o funcionamento da Theta EdgeCloud. Ao operar um Edge Node, é possível ligar GPUs e recursos computacionais locais à rede Theta.

Quando a rede deteta procura de inferência de IA, renderização de vídeo ou computação edge, atribui tarefas a estes nodos. Após a conclusão, cada nodo recebe recompensas TFUEL proporcionais aos recursos computacionais fornecidos.

Ao contrário das máquinas de mineração convencionais, os Edge Nodes da Theta não se dedicam à mineração PoW, mas sim à oferta de recursos computacionais reais. Este é um fator que posiciona a Theta como um projeto DePIN.

Para a maioria, os Edge Nodes são simultaneamente a porta de entrada na rede Theta e uma peça fundamental do seu mecanismo de partilha de recursos.

Como circula o TFUEL na EdgeCloud

O TFUEL é o utility token central da Theta EdgeCloud, servindo como meio de pagamento e incentivo dentro da rede.

Quando os programadores submetem tarefas de IA ou vídeo, pagam TFUEL como taxa de recurso. O sistema distribui parte desse TFUEL pelos Edge Nodes que participam na computação, em função da execução da tarefa.

No ecossistema EdgeCloud, o TFUEL liga:

-

Programadores de aplicações de IA

-

Fornecedores de recursos GPU

-

A rede Edge Node

-

Infraestrutura Theta

Desta forma, cria-se um ciclo de “pagamento de tarefa—execução de recurso—recompensas ao nodo”.

Cenários de aplicação principais da Theta EdgeCloud

A Theta EdgeCloud centra-se em casos de uso de IA e computação de media.

Em IA, destacam-se aplicações como:

-

Inferência de modelos de IA

-

Inferência de grandes modelos de linguagem

-

Geração de imagens

-

Computação GPU distribuída

Em vídeo e media, a Theta EdgeCloud suporta:

-

Transcodificação de vídeo

-

Renderização de vídeo

-

Processamento de transmissões em direto

-

Entrega de conteúdo em edge

Como os edge nodes estão distribuídos globalmente, tarefas que exigem elevado grau de resposta em tempo real beneficiam da computação edge, minimizando a latência.

Com a convergência entre infraestrutura de IA e Web3, a Theta EdgeCloud assume-se como peça estratégica na expansão da Theta do ecossistema de vídeo para o setor da IA.

Desafios para a Theta EdgeCloud

Apesar das redes GPU distribuídas garantirem partilha de recursos e escalabilidade, a Theta EdgeCloud enfrenta desafios concretos.

Por um lado, os edge nodes não apresentam sempre capacidades de hardware equivalentes—diferenças no desempenho das GPU podem afetar a eficiência das tarefas. Por outro, a natureza distribuída da rede complica o agendamento de recursos e a gestão das tarefas.

Simultaneamente, a competição no mercado de infraestrutura de IA acelera, com plataformas cloud tradicionais e outros projetos de redes GPU distribuídas a disputar quota de mercado.

Além disso, a crescente procura por GPU de alto desempenho, impulsionada pela IA generativa, torna o acesso estável e o agendamento eficiente destes recursos um desafio prolongado para a EdgeCloud.

Resumo

A Theta EdgeCloud, lançada pela Theta Network como plataforma descentralizada de IA e computação edge, pretende criar uma rede distribuída de computação IA ao orquestrar Edge Nodes globais e GPUs em cloud.

Em comparação com os serviços centralizados tradicionais de IA na cloud, a Theta EdgeCloud dá primazia à partilha de recursos edge, colaboração de GPU e agendamento distribuído. Os programadores submetem tarefas de inferência de IA e processamento de vídeo na plataforma, enquanto nodos globais executam essas tarefas e recebem recompensas TFUEL.

Com a procura por inferência de IA e recursos GPU em constante crescimento, a Theta EdgeCloud impulsiona a transição da Theta de plataforma de streaming de vídeo para solução global de infraestrutura de IA.

Perguntas frequentes

Como funciona a Theta EdgeCloud?

Ao submeterem tarefas de IA ou vídeo, o sistema atribui-as automaticamente a GPUs cloud e Edge Nodes para processamento colaborativo, sendo o TFUEL o meio de pagamento e recompensa de recursos.

Que função têm os Edge Nodes na EdgeCloud?

Os Edge Nodes disponibilizam recursos GPU e computacionais para executar tarefas de inferência de IA, renderização de vídeo e computação edge.

Em que difere a Theta EdgeCloud dos serviços tradicionais de IA na cloud?

Os serviços tradicionais de IA na cloud dependem de centros de dados centralizados; a Theta EdgeCloud combina edge nodes e GPUs em cloud numa rede de recursos distribuída.

Para que serve o TFUEL na EdgeCloud?

O TFUEL serve para pagar taxas de tarefas de IA e vídeo, sendo também o token de recompensa dos nodos ao finalizarem as tarefas.

A Theta EdgeCloud é um projeto DePIN?

Como o seu modelo assenta na partilha de recursos GPU e computação edge, a Theta EdgeCloud insere-se frequentemente na categoria DePIN e de rede GPU distribuída.

Artigos relacionados

Modelo Económico do Token ONDO: De que forma impulsiona o crescimento da plataforma e o envolvimento dos utilizadores?

Tokenomics da Morpho: Utilidade, distribuição e proposta de valor do MORPHO

Morpho vs. Aave: Análise aprofundada das diferenças de mecanismo e estrutura nos protocolos de empréstimos DeFi

Tokenomics do USD.AI: análise aprofundada dos casos de utilização do token CHIP e dos mecanismos de incentivos

Análise das Fontes de ganhos de USD.AI: como os empréstimos de infraestrutura de IA geram retorno