Como funciona o Theta EdgeCloud? Uma análise aprofundada de todo o fluxo de trabalho de computação de borda com IA

Os serviços de nuvem de IA tradicionais geralmente dependem de grandes data centers centralizados. Embora esse modelo forneça alto poder de computação, ele acarreta custos elevados de GPU, gestão centralizada de recursos e desafios de escalabilidade. O Theta EdgeCloud busca superar essas limitações ao integrar nós de borda à computação em nuvem, reunindo GPUs ociosas de todo o mundo em uma rede única para aumentar o aproveitamento dos recursos e impulsionar a colaboração distribuída.

Com o aumento da concorrência em infraestrutura de IA, o Theta EdgeCloud se destaca como referência em DePIN (Decentralized Physical Infrastructure Network) e redes distribuídas de GPU. Em vez de substituir as plataformas tradicionais de nuvem, o seu principal propósito é oferecer colaboração mais flexível de recursos para inferência de IA e cenários de edge computing.

O que é o Theta EdgeCloud

O Theta EdgeCloud é uma plataforma híbrida de nuvem de IA desenvolvida no ecossistema da Theta Network. Sua estratégia central combina nós de borda distribuídos com serviços tradicionais de GPU em nuvem, formando uma rede unificada de recursos computacionais.

Diferentemente dos serviços de nuvem de IA centralizados, o Theta EdgeCloud utiliza recursos não só de servidores em nuvem, mas também de nós de borda operados por usuários globalmente. Esses nós compartilham GPUs, CPUs e banda larga ociosas para executar tarefas de inferência de IA, transcodificação de vídeo e renderização.

Para desenvolvedores, o Theta EdgeCloud funciona como uma camada computacional de IA que orquestra recursos distribuídos de forma dinâmica. Basta submeter as tarefas pela plataforma e o sistema cuida automaticamente da alocação e execução dos recursos — eliminando o gerenciamento manual de Nós.

Como o Theta EdgeCloud difere dos serviços tradicionais de nuvem de IA

Plataformas de nuvem de IA tradicionais dependem de grandes data centers para fornecer serviços centralizados de GPU, com o gerenciamento de recursos sob responsabilidade da provedora de nuvem. Apesar da estabilidade e maturidade, esse modelo é suscetível à escassez de GPUs e ao aumento dos custos.

Já o Theta EdgeCloud prioriza o "compartilhamento de recursos de borda". Nós de borda em todo o mundo podem disponibilizar GPUs ociosas para uso compartilhado. Quando um trabalho de IA é submetido, a plataforma aloca recursos conforme as necessidades da tarefa, status dos nós e capacidade de processamento disponível.

As principais diferenças entre o Theta EdgeCloud e plataformas tradicionais de nuvem de IA incluem:

| Dimensão de comparação | Plataforma tradicional de nuvem de IA | Theta EdgeCloud |

|---|---|---|

| Origem do recurso | Data center centralizado | GPU em nuvem + nó de borda |

| Estrutura da rede | Centralizada | Distribuída |

| Agendamento de GPU | Gestão centralizada da plataforma | Colaboração dinâmica entre nós |

| Participação dos nós | Provedor de serviço de nuvem | Recursos disponibilizados por usuários |

| Mecanismo de incentivo | Taxas de serviço | Mecanismo de Recompensa TFUEL |

Esse modelo posiciona o Theta EdgeCloud como uma rede de GPU verdadeiramente distribuída, e não apenas uma plataforma convencional de computação em nuvem.

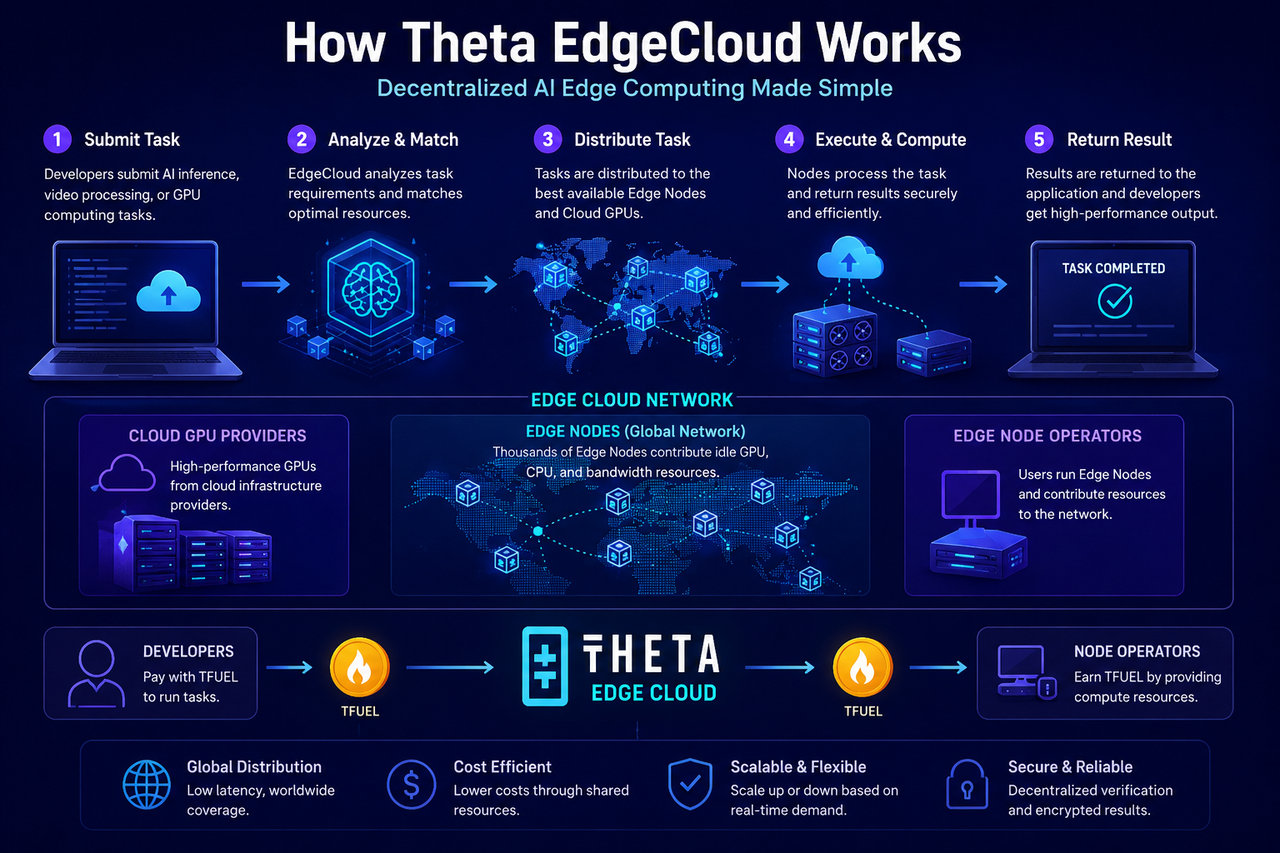

O que acontece quando usuários submetem tarefas de IA

Quando desenvolvedores ou aplicações submetem tarefas de inferência de IA, processamento de vídeo ou renderização, o Theta EdgeCloud analisa os requisitos de recursos, incluindo tipo de GPU, memória, tempo de computação e banda larga.

O sistema identifica os nós mais adequados na rede. Algumas tarefas são processadas em GPUs em nuvem, enquanto outras são distribuídas a nós de borda ao redor do mundo para processamento colaborativo. Todo o processo é automatizado, sem necessidade de seleção manual de nós pelos desenvolvedores.

Durante a execução, o sistema monitora continuamente o status dos nós e o progresso das tarefas. Caso determinados nós fiquem offline ou faltem recursos, a plataforma realoca as tarefas conforme necessário para garantir a estabilidade do processamento.

Ao concluir, os resultados são retornados à camada de aplicação e os nós participantes recebem recompensas em TFUEL proporcionais à contribuição de recursos.

Na prática, trata-se de um "sistema de agendamento distribuído de recurso" que unifica o uso do poder computacional ocioso em toda a rede.

Como nós de borda contribuem para o processamento de GPU

Os Nós de Borda são fundamentais para o Theta EdgeCloud. Ao operar um Nó de Borda, usuários podem conectar suas GPUs e recursos computacionais locais à rede Theta.

Quando há demanda por inferência de IA, renderização de vídeo ou edge computing, as tarefas são atribuídas a esses nós. Após a execução, os nós recebem TFUEL de acordo com a quantidade de recursos computacionais fornecidos.

Diferente das máquinas de mineração convencionais, os nós de borda do Theta não realizam mineração PoW, mas disponibilizam recursos computacionais reais. Essa característica faz com que o Theta seja amplamente reconhecido como um projeto DePIN.

Para a maioria dos usuários, os nós de borda são o principal ponto de entrada na rede Theta e elemento-chave do mecanismo de compartilhamento de recursos.

Como o TFUEL circula no EdgeCloud

O TFUEL é o principal token de utilidade do Theta EdgeCloud, atuando tanto como forma de pagamento quanto como incentivo dentro da rede.

Ao submeter tarefas de IA ou vídeo, desenvolvedores pagam taxas em TFUEL. O sistema distribui parte desse TFUEL aos nós de borda participantes de acordo com a execução das tarefas.

No ecossistema EdgeCloud, o TFUEL conecta:

-

Desenvolvedores de aplicações de IA

-

Provedores de recursos de GPU

-

A rede de Nós de Borda

-

A infraestrutura Theta

Isso cria um mecanismo cíclico de "pagamento por tarefa — execução de recursos — recompensas aos nós".

Principais cenários de uso do Theta EdgeCloud

O Theta EdgeCloud foca principalmente em aplicações de IA e computação de mídia.

Na área de IA, as aplicações incluem:

-

Inferência de modelos de IA

-

Inferência de grandes modelos de linguagem

-

Geração de imagens

-

Computação distribuída de GPU

Em vídeo e mídia, o Theta EdgeCloud oferece suporte a:

-

Transcodificação de vídeo

-

Renderização de vídeo

-

Processamento de transmissões ao vivo

-

Entrega de conteúdo na borda

Como os Nós de Borda estão distribuídos globalmente, tarefas com alta demanda de tempo real aproveitam edge computing para reduzir a latência.

Com a convergência entre infraestrutura de IA e Web3, o Theta EdgeCloud consolida o papel da Theta na expansão do ecossistema de vídeo para o segmento de IA.

Desafios do Theta EdgeCloud

Apesar das vantagens em compartilhamento de recursos e escalabilidade das redes distribuídas de GPU, o Theta EdgeCloud ainda enfrenta desafios práticos.

Nem todos os nós de borda possuem hardware padronizado — diferenças no desempenho das GPUs podem afetar a eficiência das tarefas. Além disso, a natureza distribuída da rede aumenta a complexidade do agendamento de recursos e da gestão das tarefas.

Ao mesmo tempo, a competição no mercado de infraestrutura de IA se intensifica, com plataformas tradicionais de nuvem e outros projetos de redes distribuídas de GPU disputando o mercado de computação em IA.

A demanda crescente por GPUs de alto desempenho, impulsionada pela IA generativa, torna o acesso estável e o agendamento de recursos de GPU um desafio contínuo para o EdgeCloud.

Resumo

O Theta EdgeCloud, lançado pela Theta Network como plataforma descentralizada de IA e edge computing, tem como missão construir uma rede distribuída de computação de IA por meio da orquestração de nós de borda globais e GPUs em nuvem.

Em comparação aos serviços centralizados de nuvem de IA, o Theta EdgeCloud prioriza o compartilhamento de recursos de borda, colaboração de GPU e agendamento distribuído. Desenvolvedores submetem tarefas de inferência de IA e processamento de vídeo pela plataforma, enquanto nós em todo o mundo executam essas tarefas e recebem TFUEL como recompensa.

Com a crescente demanda por inferência de IA e recursos de GPU, o Theta EdgeCloud acelera a evolução da Theta de uma plataforma de streaming de vídeo para uma solução abrangente de infraestrutura de IA.

Perguntas Frequentes

Como o Theta EdgeCloud funciona?

Quando desenvolvedores submetem tarefas de IA ou vídeo, o sistema atribui automaticamente essas tarefas a GPUs em nuvem e nós de borda para processamento colaborativo, com o TFUEL sendo utilizado para pagamento e recompensas de recursos.

Qual o papel dos nós de borda no EdgeCloud?

Os nós de borda fornecem recursos de GPU e computação para executar tarefas de inferência de IA, renderização de vídeo e edge computing.

Como o Theta EdgeCloud se diferencia dos serviços de nuvem de IA tradicionais?

Serviços tradicionais de nuvem de IA utilizam data centers centralizados, enquanto o Theta EdgeCloud integra nós de borda e GPUs em nuvem para criar uma rede distribuída de recursos.

Para que serve o TFUEL no EdgeCloud?

O TFUEL é utilizado para pagar taxas de tarefas de IA e vídeo e, também, como token de recompensa para os nós ao término das execuções.

O Theta EdgeCloud é um projeto DePIN?

Como o modelo central do Theta EdgeCloud se baseia no compartilhamento de recursos de GPU e edge computing, ele é frequentemente classificado como projeto DePIN e rede distribuída de GPU.

Artigos Relacionados

Morpho vs Aave: Análise comparativa dos mecanismos e diferenças estruturais nos protocolos de empréstimo DeFi

Tokenomics da Morpho: utilidade do MORPHO, distribuição e proposta de valor

Quais são os casos de uso do token ST? Um olhar aprofundado sobre o mecanismo de incentivo do ecossistema Sentio

Modelo Econômico do Token ONDO: como ele impulsiona o crescimento da plataforma e o engajamento dos usuários?

Sentio vs The Graph: uma comparação entre mecanismos de indexação em tempo real e indexação por subgraph